研究プロジェクト

競争的外部予算・企業との共同研究を中心とした山田研が深く関わっている研究プロジェクトです。

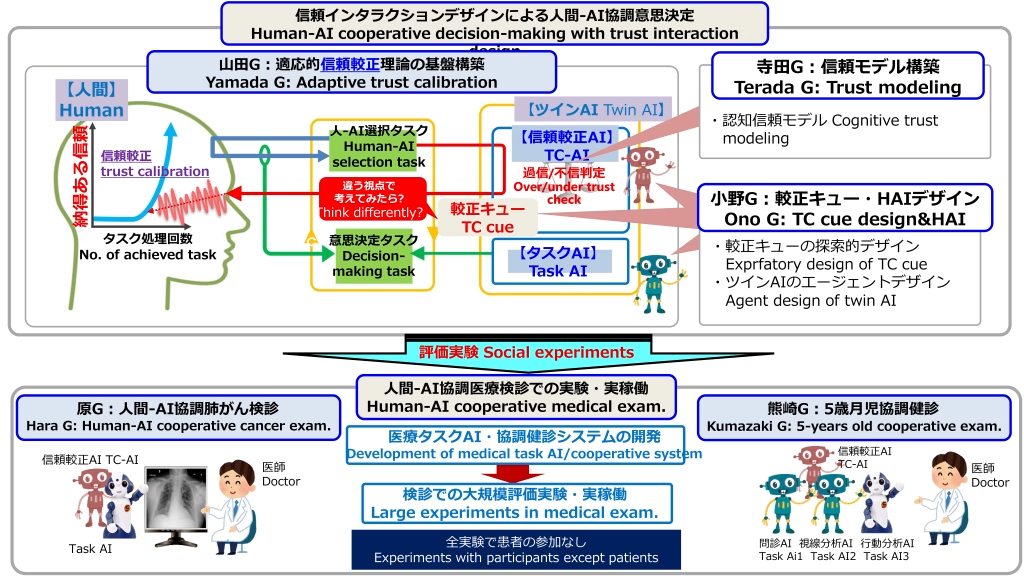

科学技術振興機構 JST CREST 山田チーム『納得感のある人間-AI協調意思決定を目指す信頼インタラクションデザインの基盤構築と社会7浸透』

- 領域:『信頼されるAIシステムを支える基盤技術』(総括:相澤 彰子(国立情報学研究所))

- 研究代表者:山田誠二(神奈川大学)

- 主たる共同研究者:寺田 和憲(岐阜大学)、小野 哲雄(京都橘大学)、原 武史(岐阜大学)、熊崎 博一(長崎大学)

- 研究期間:2021年10月~2027年3月

信頼較正という技術を中心にして、AIに対する過信(信頼し過ぎ)・不信(信頼しなさ過ぎ)を自動検知し、ユーザに較正を促す適応的信頼較正システムの理論と応用を遂行します。また、その成果を医療AI(画像診断・発達障害スクリーニング)に応用します。

詳細は、山田CREST webページをご覧下さい。

真壁CREST科学技術振興機構 JST CREST 山田チーム『納得感のある人間-AI協調意思決定を目指す信頼インタラクションデザインの基盤構築と社会7浸透』

- 領域:『信頼されるAIシステムを支える基盤技術』(総括:相澤 彰子(国立情報学研究所))

- 研究代表者:真壁 竜介(国立極地研究所)

- 主たる共同研究者:山田 誠二(神奈川大学)、野村 大樹(北海道大学)

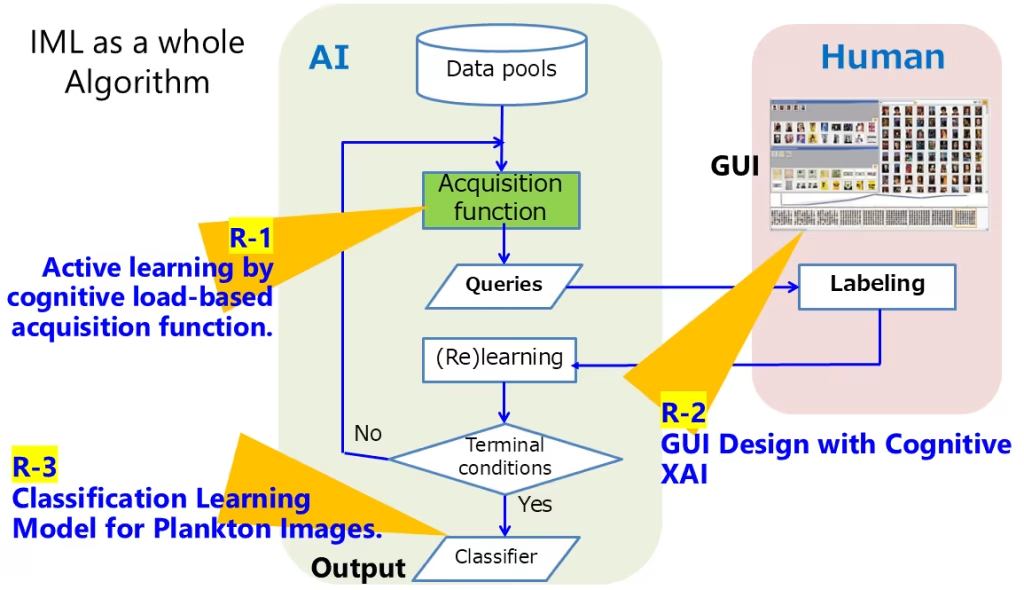

● 山田グループの研究テーマ

- R-1 ラベル付け認知負荷モデルによる能動学習:従来の能動学習(ラベル付けの訓練データの最適選択問題)では扱われてこなかった重要な要因であるラベル付けの認知負荷を画像そのものとラベル付けを行う人間のデモグラフィックデータから見積もる認知負荷モデルを関数同定して、その認知負荷モデルを導入した獲得関数を開発し、より実際のコストを反映した新しい能動学習アルゴリズムを開発し、評価実験を行う。

- R-2 プランクトン画像ラベル付けのための認知的XAIデザイン:参加者実験によるデータから因果関係の強さを学習しながら、人間が探索的構成を行うトップダウンな認知モデルである構造方程式モデリングをベースとして、XAIの説明生成をデザインする手法を我々は開発してきた。この認知的XAIデザイン法をプランクトン画像の分類学習のためのUIデザインに応用する。

- R-3 プランクトン画像の教師あり分類学習:プランクトン画像のラベル付けを行うことで得られる訓練データを用いて、教師あり分類学習を実行し、画像ベースのブランクトン分類を自動化する。用いる分類学習アルゴリズムは、特徴エンジニアリング+SVM | XGboost、CNN、半教師あり学習などを試し、それらの性能比較を行う。

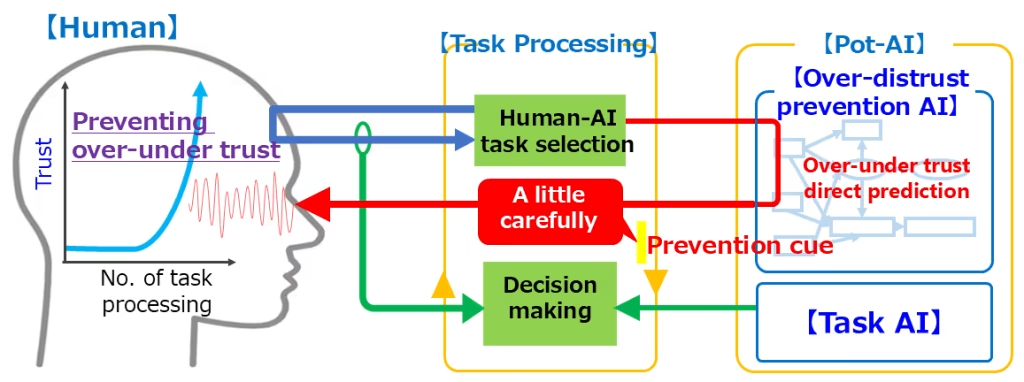

基盤研究(A)(一般)『AIに対する人間の過信・不信メカニズムの実験的解明と過不信予防AIへの応用 』

研究代表:山田誠二、研究期間:2024年度 ~ 2027年度

- 研究代表者:山田 誠二(神奈川大学)、研究分担者:小野 哲雄(京都橘大学)

- 研究期間:2024年4月~2028年3月

昨今のChatGPTや自動運転の普及により人間-AI協調意思決定が日常的になるに伴って、新たな課題が顕在化してきた。その課題の一つとして、人間がAIを信頼し過ぎてしまう過信と逆に過度に信頼しない不信がある。この過不信を抑制するために、本研究では『AIに対する人間の過不信に注目し、認知モデリングによってそのメカニズムを解明し、それを予防できるAIを構築する』。

提案する過不信予測モデルは、要因と因果関係からなる有向グラフで表現され、設計者がトップダウンに設計できる過不信の発生予測モデルである。そして、このモデルに基づき過不信を予防可能なAIシステム:POT-AIを提案する。POT-AIは、過不信の発生を予測し、適時予防キューと呼ばれる刺激をユーザに表出することで過不信をあらかじめ抑制できる。予防キューの設計には、人間の主体性を担保して行動変容を促すナッジ技術が用いられる。

そして、リアルタイムな過不信回避が必須である自動車やドローンの自動運転(レベル3)にPOT-AIを実装し、仮想的・物理的シミュレーションを用いた参加者実験により過信不信予測モデルおよびPOT-AIの有効性を検証する。